В ученой среде традиционно считают, что нельзя привносить этические или политические ценности в научный процесс. Но что, если исследования порождают проблемы безопасности, вызывают расистские настроения или представляют угрозу для окружающей среды? Ученым мужам стоило бы — как недавно решили компьютерщики — официально заявить о включении этической рефлексии в свою практику, чтобы достичь более просоциальных результатов.

Мобилизовать целую область науки на фундаментальные подвижки — задача непростая. Один из возможных способов — изменение стадии научно-исследовательского процесса, имеющей решающее значение для доверия общества. Речь идет о стадии экспертной оценки.

NeurIPS 2020: развернутое заявление о воздействии ИИ на общество

В 2020 году организаторы NeurIPS, крупнейшей конференции по машинному обучению, потребовали, чтобы каждый участник представил развернутое заявление о влиянии ИИ на общество:

“Для обеспечения сбалансированного подхода к научной деятельности, авторы должны сделать развернутые заявления о потенциальном воздействии их исследований на общество, включая этические аспекты и будущие социальные последствия. Авторам следует подготовиться к обсуждению как положительных, так и отрицательных результатов”.

NeurIPS — это масштабная конференция. В 2020 году было принято почти 2000 работ. Хотя развернутое заявление о воздействии ИИ не являлось единственным основанием для отказа в одобрении статьи, материалы могли быть отклонены по этическим соображениям. Таким образом, тысячи исследователей задумались о социальных последствиях своей работы в рамках нового требования. Организаторы конференции не разработали дополнительных указаний относительно составления заявления. Поэтому авторы должны были сами решить, как расставить тематические приоритеты, какие сроки воздействия ИИ обсудить, как трактовать неопределенность будущих результатов и т. д.

Представленные заявления можно считать зеркалом, отражающим умонастроения ИИ-сообщества в решающий переломный момент. Они показывают, как исследователи отвечают на вызовы этики, которая сигнализирует о том, что может работать, чего потенциально не хватает и как двигаться вперед.

Наш анализ

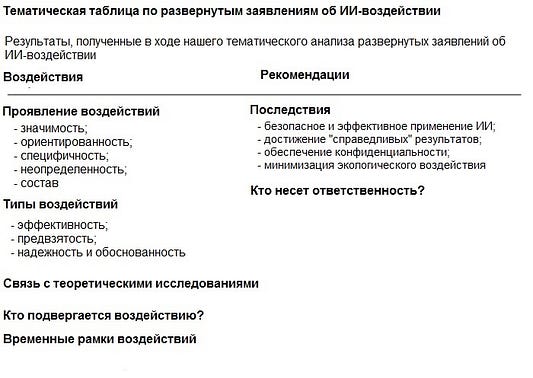

Наша команда провела качественный тематический анализ выборки из 300 развернутых заявлений о воздействии ИИ на социум, представленных на NeurIPS 2020 (вот набор данных). Наш анализ затрагивает несколько ключевых моментов относительно того, на чем фокусируются авторы и как они это делают. Мы включили наши наблюдения в приведенную ниже тематическую таблицу с несколькими разделами и подразделами.

Воздействия

Раздел “Воздействия” отражает, как и какие воздействия представлены в заявлениях, а также кто и когда ощутит на себе их последствия.

Как авторы описывают проявление воздействий ИИ?

Мы пришли к выводу, что исследователи по-разному характеризуют последствия влияния искусственного интеллекта на общество. В этом вопросе мы выделили 5 направлений:

- значимость последствий, как положительных, так и отрицательных;

- ориентированность на технические результаты или общественные ценности;

- специфика последствий — от сугубо контекстуальных и узконаправленных до более общих;

- неопределенность результатов как признание того, что модель может потерпеть неудачу впоследствии;

- состав письменных заявлений по предыдущим направлениям.

Часть результатов ИИ-воздействий описаны с точки зрения технического вклада. Так, некоторые авторы утверждают, что их методы сокращают время или ресурсы обучения (подразумевается, что это само по себе является положительным результатом работы). Другие социально ориентированные авторы, как правило, пишут о влиянии ИИ на частную жизнь, например, о привлечении ИИ к решению проблемы наблюдения. Аргументация в пользу технической направленности результатов ИИ-исследований явно противоречит духу заявлений, призывающих к обсуждению социальных последствий ИИ-изысканий.

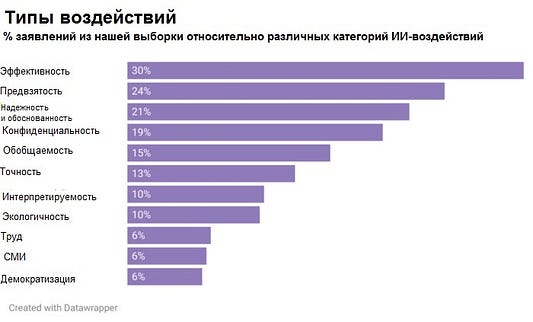

На каких типах воздействий фокусируются исследователи?

Мы обнаружили, что авторы заявлений сосредотачиваются на темах, указанных на графике ниже. Мы описали конкретные модели воздействия в рамках каждой темы, а также отметили основную направленность темы как преимущественно техническую или общественно ориентированную. Интересно, что эффективность — это наиболее часто встречающаяся тема, в основном связанная с техническими аспектами. Теме предвзятости (включая вопросы справедливости) также уделяют значительное внимание, характеризуя ее как с технической, так и социальной стороны; конфиденциальность — еще одна относительно распространенная тема, но о ней пишут в основном в отношении общества. Меньшее количество авторов озабочены воздействием ИИ на окружающую среду, угрозами дипфейков (категория “СМИ”) и влиянием искусственного интеллекта на занятость (категория “Труд”).

Авторы расходятся во мнениях о том, имеет ли теоретическая деятельность социальные последствия. 9 % заявлений указывают на то, что теоретический характер работы не предполагает получения прогнозируемых, этических или негативных социальных результатов. С другой стороны, 10 % заявителей отмечают связь между теоретическими разработками и возможными социальными последствиями. Было бы интересно выяснить, что приводит авторов к столь различным выводам.

Кто подвергается воздействию ИИ?

Авторы более половины заявлений из нашей выборки (64 %) указывают, на кого может повлиять их работа. Мы выделили несколько групп упомянутых лиц:

- представители больших общественных прослоек (например, работники всего здравоохранения);

- личности с конкретными признаками или возможностями;

- люди, занятые в определенной отрасли (например, в креативной индустрии);

- сравнительно широкие комьюнити (например, пользователи социальных сетей);

- исторически неблагополучные группы;

- ученые-теоретики и исследователи-практики.

Когда общество увидит эти последствия?

Только около 10 % заявителей из нашей выборки называют сроки воздействия ИИ на общество. Авторы пишут о временных рамках в обобщенном плане — краткосрочном или долгосрочном воздействии либо об ускоренных темпах достижения какого-то результата.

Рекомендации

Авторы заявлений, как правило, гораздо меньше внимания уделяют рекомендациям по ослаблению негативных последствий. Тем не менее, они делают различные предложения о том, как достичь следующих четырех результатов:

- безопасное и эффективное использование ИИ (21 %);

- стремление к “справедливым” результатам (6 %);

- обеспечение конфиденциальности (5 %);

- минимизация воздействия на окружающую среду (1 %).

Очевидно, что сообщество исследователей ИИ готово выполнять эти рекомендации и принимать соответствующие решения при поиске позитивных путей продвижения.

Однако для некоторых исследователей остается неясным, кто должен нести ответственность за выполнение рекомендованных ими действий (7 % заявлений). В 24 % заявлений так или иначе упоминается о том, на кого возлагается ответственность. Некоторые упомянутые ответственные стороны включают в себя ученых, политиков и лиц, непосредственно заинтересованных в продвижении ИИ, таких как исследователи-практики или разработчики систем.

Заглядывая в будущее

Итак, было ли успешно выполнено требование о предоставлении развернутого заявления о влиянии ИИ? Трудно ответить на этот вопрос, потому что предполагаемые цели самого требования кажутся неоднозначными. Мы предлагаем собственные формулировки этих целей с включением идей по их достижению при условии оптимизации вышеупомянутого заявления:

- Поощрять рефлексивность: Для дальнейшего поощрения рефлексивности мы предлагаем предоставить авторам дополнительные рекомендации по сопоставлению технического и общественного эффектов от ИИ (например, в соответствии с требованиями Ashurst LLP и прочих аудиторов к платформе “Impact Stack”, связанной с официальным руководством NeurIPS 2020).

- Инициировать изменения в проведении будущих исследованиях: Чтобы добиваться социально ориентированных результатов, исследователям стоит заниматься составлением развернутого заявления о влиянии ИИ на более раннем этапе исследовательского процесса. Тогда у них будет возможность своевременно вносить существенные изменения в свои изыскания.

- Свести к минимуму проявление халатности и безответственности: Для исследователей ИИ было бы полезно изучить комплекс этических проблем, связанных с их сферой деятельности. Это позволит успешнее выявлять и смягчать потенциальные риски.

Развернутые заявления о социальном воздействии ИИ, инициированные NeurIPS 2020, знаменует собой переломный момент в области компьютерных наук. Пришло время для более пристального внимания к проблемам ИИ-этики. Эта молодая область знаний не устает экспериментировать в поисках новых подходов к урегулированию вопросов социального влияния ИИ.

Мы будем рады узнать ваше мнение о наших выводах, а также о том, какую роль могут сыграть развернутые заявления о ИИ-воздействии в дальнейших исследованиях.

Читайте также:

- О машинном обучении простым языком

- Искусственный интеллект: надежды и угрозы

- ИИ-технологии на службе у инфлюенс-маркетинга

Читайте нас в Telegram, VK и Яндекс.Дзен

Перевод статьи Priyanka Nanayakkara, Here’s how AI researchers are thinking about the societal impacts of AI