Недавно скончался нобелевский лауреат по экономике Даниэль Канеман. Наибольшую известность ему принесли исследования в области принятия решений человеком и выявлении различных заблуждений/предубеждений, влияющих на этот процесс. Книга Канемана “Мышление, быстрое и медленное” (“Thinking, Fast and Slow”) перевернула мое сознание. Есть только две книги (“Дон Кихот” М. Сервантеса и “Государь” Н. Макиавелли), о которых я мог бы сказать то же самое.

Вот почему мне хочется убедить и вас прочитать этот исключительный труд.

Основная мысль книги

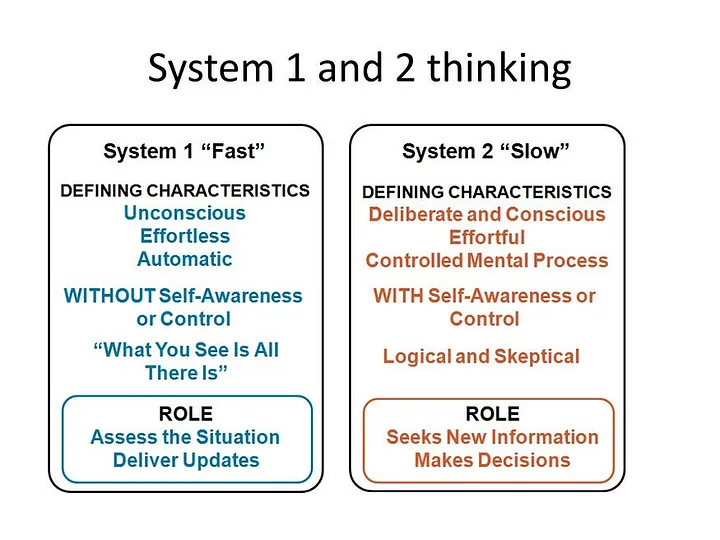

В механизме мышления, благодаря которому человек принимает решения, работают две системы.

- Система 1 (С1): быстрая, автоматическая, интуитивная и эмоциональная. Эта система по умолчанию используется нашим мозгом.

- Система 2 (С2): медленная, требующая усилий, логики и концентрации. Эту систему необходимо активировать с помощью сознания. Поскольку она требует больших усилий, мы не можем использовать ее по умолчанию. Кроме того, С1 часто искажает результаты анализа, который проводит С2 (примером может служить предвзятость подтверждения: наш анализ (С2) нередко строится на основе тщательно отобранных примеров, соответствующих нашим первоначальным представлениям/инстинктивным ощущениям (С1)). Поэтому осознание своих предубеждений является ключом к принятию эффективных решений: оно позволяет противостоять глубинному давлению С1, искажающему решения.

В книге подробно рассказывается о том, как эти две системы влияют на процесс принятия решений, а также о различных когнитивных искажениях, обусловленных особенностями механизма мышления.

Почему стоит прочесть эту книгу

Мы живем в мире, где все зависит от скорости получения информации и мгновенных решений. Сенсорная перегрузка усиливает слабые стороны нашей С1, приводя к автоматическим суждениям и отсутствию критического мышления. Книга “Мышление, быстрое и медленное” стала для меня противоядием. Изучение предубеждений заставило меня многое пересмотреть и подвергнуть сомнению, отказаться от автоматических реакций и поспешных решений (большая часть моих работ возникла из-за осознания искаженных базовых представлений). Кроме того, эта книга помогает избавиться от самонадеянности.

Как нужно читать

В книге подробно рассказывается об экспериментах и их последствиях. Это затрудняет чтение. Такие книги не предназначены для прочтения за один-два дня (если только вас не интересует организация самих экспериментов). Я бы рекомендовал читать эту книгу в течение нескольких месяцев, периодически возвращаясь к прочитанному, чтобы изучить различные типы предубеждений и вникнуть в суть экспериментов. Лично я получил массу удовольствия, анализируя постановку описанных экспериментов и размышляя над тем, как бы я их провел. Но, что еще важнее, я стал понимать, как различные PR-коммуникации/маркетинговые сообщения в интернете пытаются использовать наши предубеждения, чтобы убедить нас следовать их рекомендациям.

Книга Канемана сделала меня менее уязвимым перед пиар-ловушками и рекламной ложью, заполонившими интернет. Поэтому в оставшейся части статьи хочу поделиться наиболее важными открытиями, которыми я обязан этой книге (как прямо, так и косвенно).

Система 1 как источник предубеждений

Мышление по С1 — по умолчанию процесс быстрый, автоматический и не требующий усилий. Он опирается на интуицию, эмоции и усвоенные шаблоны. Вот ключевые характеристики С1:

- Быстрота и автоматизм. С1 обрабатывает информацию быстро и без особых сознательных усилий. Эта система работает с рефлексами, мгновенно откликаясь на любимую музыку, звучащую в общественном месте. С1 всегда активирована, позволяя при этом воспринимать окружающий мир, не перегружаясь сенсорной информацией. Вот почему так много рекламы и медиакоммуникаций опираются на образы и эмоции: С1 обрабатывает их до того, как включается критическое мышление.

- Распознавание образов. С1 отлично справляется с выявлением закономерностей и вынесением быстрых суждений на основе прошлого опыта. Эта система использует мыслительные связи (шаблоны восприятия), называемые эвристикой, позволяя нам эффективно ориентироваться в окружающем мире.

- Эмоциональный подход. Эмоции играют важную роль в мышлении по С1. Мы часто принимаем импульсивные решения, основанные на таких чувствах, как страх, гнев и волнение.

- Сила воздействия. С1 управляет большей частью нашего мышления и может оказывать влияние на С2 даже тогда, когда мы этого не хотим. В книге Канемана читателю предлагается множество тестов/вопросов с подвохом. Я обнаружил, что попадаюсь на различные уловки, даже зная позицию автора и ожидая подвоха. Многие из этих трюков провоцируют когнитивные искажения, такие как эффект якорения/привязки и эффект фрейминга/ограничений, заставляющие С1 сосредоточиться на определенных фрагментах информации, пренебрегая другими. Это приводит к ложным выводам, поскольку С2 приходиться работать с “неполноценными данными”.

Система 2: медленный и взвешенный мыслительный процесс

С2 — способ мышления, требующий больших временных и энергетических затрат. Вот что отличает С2:

- Неспешность и расчетливость. С2 нуждается во времени и сознательных усилиях для активации. Она используется для сложных расчетов, критического мышления и решения проблем.

- Логика и здравый смысл. С2 опирается на логику и здравый смысл, чтобы анализировать информацию и принимать решения. С ее помощью мы решаем математические задачи или взвешиваем различные варианты, прежде чем сделать выбор.

- Ограниченные возможности. С2 имеет ограниченные ресурсы и может легко перегрузиться. Поэтому в большинстве повседневных задач мы больше полагаемся на С1 (и это хорошо).

От того, как взаимодействуют эти системы, зависит наше мышление.

Как когнитивные предубеждения формируют взаимодействие двух систем

Хотя эти системы работают вместе, С1 часто играет ведущую роль. Ее эффективность не позволяет нашему мозгу постоянно вязнуть в аналитическом параличе. Это достигается за счет использования когнитивных предубеждений. Хотя к слову “предубеждения” часто относятся как к ругательству, стоящее за ним понятие является ценностно-нейтральным. С точки зрения теории информации, предубеждение — просто искажение, которое модель принятия решений (будь то человеческий мозг или искусственный интеллект) использует для расстановки приоритетов и обработки информации.

Это искажение может быть позитивным (воздержание от продукта, который странно пахнет), нейтральным (мое отношение к шоколадному молоку) или негативным (расовые предрассудки). Разница между предрассудками человека и ИИ заключается в том, откуда они берутся: человеческие предрассудки являются порождением механизма мышления, в то время как предрассудки ИИ свидетельствуют о проблемах глубокого обучения.

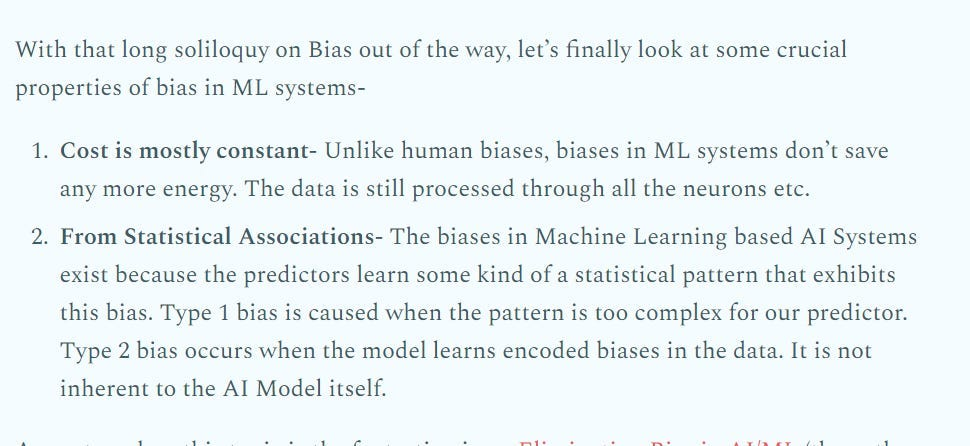

Покончив с длинным описанием предубеждений, рассмотрим некоторые важные свойства предвзятости в системах МО.

- Затраты в основном постоянные. Предубеждения в системах МО, в отличие от человеческих, не экономят энергию. Данные все равно обрабатываются всеми нейронами и т. д.

- Связь со статистикой. Предубеждения в системах ИИ, основанных на МО, существуют потому, что предикторы изучают некую статистическую закономерность, выявляющую это предубеждение. Первый тип предубеждений возникает, когда модель слишком сложна для предиктора. Второй тип предубеждений возникает, когда модель обучается на данных с закодированными предубеждениями. Самой модели ИИ не присущи предубеждения.

С точки зрения ИИ, С1 — простой чекер (модуль проверки данных), а С2 — гораздо более мощная модель глубокого обучения. Однако в большинстве случаев С1 также действует как выделитель признаков/конвейер данных, напрямую подающий входные данные в С2. Вот 2 основных способа выполнения этой роли:

- Предвзятость подтверждения. Предвзятость подтверждения С1 укрепляет имеющиеся у нас убеждения, выискивая информацию, которая их подтверждает, и игнорируя информацию, которая им противоречит. Это создает искаженное восприятие реальности.

- Эффект фрейминга. Способ/форма подачи информации может повлиять на наши решения, даже если основные факты остаются неизменными. С1 более восприимчива к эффекту фрейминга, что приводит к выбору под влиянием презентации, а не логики.

Можно потратить всю жизнь на изучение того, почему вы, ваша мама и селекционный отдел “Манчестер Юнайтед” принимают ужасные решения. Правда, есть опасность увлечься роликами с трюком “вращение на 360”, исполняемым Антони (игроком ФК “Манчестер Юнайтед”). Так что лучше отказаться от этой затеи и послушать Филиппо Марино — эксперта в области оценки рисков и принятия решений:

Наши суждения о рисках часто затуманены инстинктивным предубеждением против всего драматического и запоминающегося. Например, террористические атаки, несмотря на их относительную редкость, занимают большое место в нашем коллективном сознании. Это результат “эвристики доступности” — когнитивного искажения, когда преувеличивается вероятность событий, которые бросаются в глаза и легко запоминаются, в то время как риски, связанные с более распространенными и статистически более опасными ситуациями, преуменьшаются или игнорируются.

Аналогичным образом, наши суждения часто искажаются из-за “пренебрежения базовой информацией” — тенденции игнорировать общие статистические данные и сосредотачиваться на конкретных эпизодических случаях. При такой предвзятости наш недавний опыт посещения чужого города, например, может показаться более значимым, чем (более предсказуемые) показатели насильственных преступлений или дорожно-транспортных происшествий в этом городе.

В каждом из этих случаев наша инстинктивная оценка риска оказывается несостоятельной, что подчеркивает необходимость принятия решений с использованием достоверных данных и рационального анализа.

Теперь обсудим самые мощные идеи книги Канемана “Мышление, быстрое и медленное”.

Предубеждения, феномены и ограничения

Возврат к среднему

Возврат к среднему — статистическая концепция, согласно которой за экстремальными результатами/событиями следуют менее экстремальные результаты/события, пока ситуация не вернется к среднему значению. Звучит очевидно, но понимание последствий этой тенденции является ключевым для любого лица, принимающего решения (особенно для тех, кто работает с данными).

Почему это происходит?

Несколько факторов способствуют возврату к среднему:

- Случайное изменение. На любой результат влияет случайность. Исключительный результат может быть просто результатом стечения обстоятельств или внешних факторов, которые вряд ли повторятся.

- Погрешность измерения. Тесты и измерения не идеальны. Необычно высокие или низкие оценки могут частично зависеть от погрешности измерений, что впоследствии приведет к получению более средних результатов.

- Стабильность. Большинству систем свойственно достигать среднего значения и стремиться к равновесию. Отклонения от среднего значения обычно со временем корректируются.

Почему это важно?

Понимание возврата к среднему позволяет избежать некорректных суждений в различных сферах:

- Неверное толкование результатов. Интерпретируя итоги какой-либо деятельности, следует быть осторожным, чтобы не переоценить влияние одного экстремального показателя, положительного или отрицательного. Возврат к среднему говорит о том, что экстремальные показатели могут быть отчасти случайностью, а не истинным отражением постоянных изменений.

- Оценка вмешательства. При наблюдении экстремального улучшения после внесения изменений (например, запуске обновленной программы обучения сотрудников) велик соблазн приписать заслугу исключительно вмешательству. Однако в данном случае нельзя исключать возврата к среднему, что стоит учитывать для адекватной оценки изменений.

- Прогнозирование будущего. Концепция возврата к среднему убеждает в том, что чрезмерная экстраполяция от недавних экстремальных результатов часто вводит в заблуждение. Будущие результаты, скорее всего, будут менее экстремальными. Поэтому очень важно повысить качество выборки данных и понять базовую предметную область, поскольку и то, и другое помогает оценить, является ли конкретный набор предварительных данных хорошей моделью для прогнозирования будущего.

Мне потребовалось много времени, чтобы убедиться в этом, но теперь я вижу доказательства повсеместно (в том числе и в цифрах, с которыми имею дело).

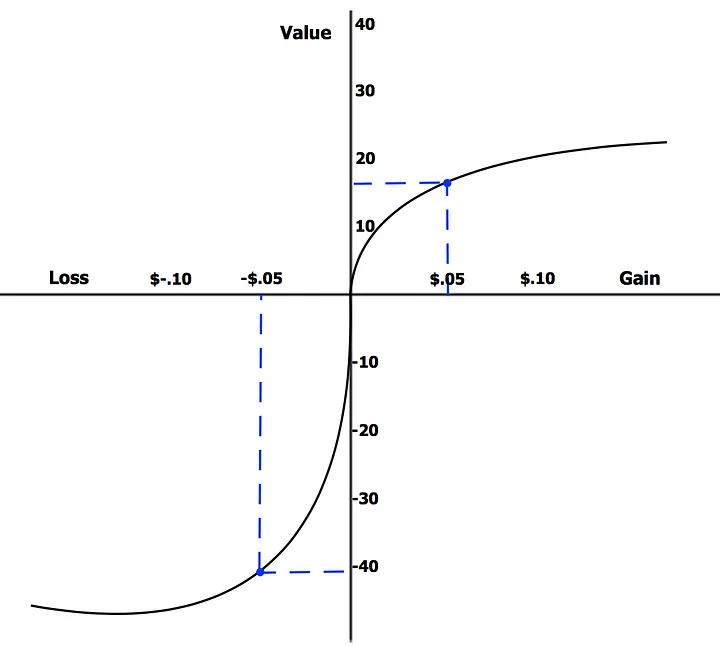

Неприятие потерь

Исследование Канемана о неприятии потерь изменило мое отношение к рискам. Наше стремление избежать потерь в 2,5 раза сильнее, чем стремление к выигрышам аналогичного масштаба.

Возможно, это произошло в результате эволюции (в джунглях чрезмерный риск мог привести к смерти, а выживали только люди консервативного склада). Мы унаследовали это поведение, хотя оно не совсем подходит для современного мира.

Понимание неприятия потерь в некотором смысле освободило меня, позволив больше экспериментировать как в личной жизни, так и в профессиональной деятельности.

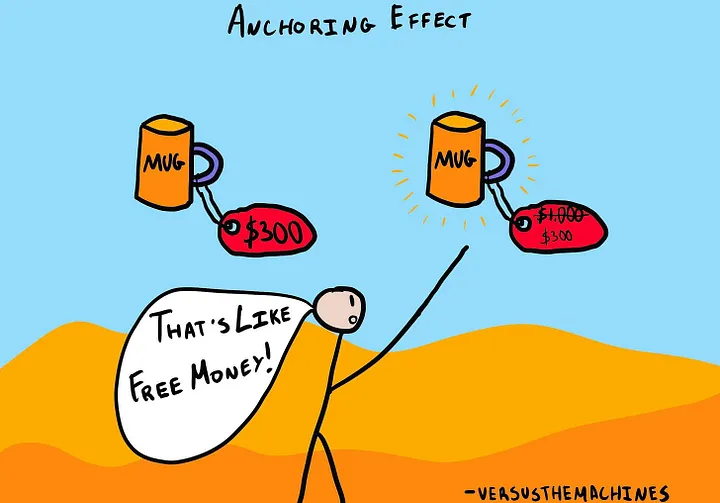

Эффект якорения

У нас есть склонность чрезмерно зацикливаться на первой предложенной информации (“якориться”). Это предубеждение часто используется в переговорах с потенциальным сотрудником о зарплате с целью занизить ее. А организации, которые пытаются нам что-то продать, наоборот, завышают цену.

Два момента, связанные с эффектом якорения, особенно поразили меня. Во-первых, оказывается, в качестве “якоря/привязки” могут использоваться совершенно не относящиеся к делу вещи. Это очень тонкий трюк, поэтому надо быть внимательным, чтобы не поддаться на него. Во-вторых, эффект якорения может усугубить влияние предубеждения автоматизации — нашей склонности менее критически воспринимать результаты автоматизированной системы принятия решений.

Ответы, получаемые от моделей ИИ, способны вызывать у нас эффект якорения и, таким образом, влиять на принятие решений. Прибегая к помощи инструмента на основе ИИ, человек может сформировать искаженное суждение, привязавшись к первому полученному ответу и игнорируя другие варианты решения. Это ограничивает нас в принятии решений.

Считается, что нехватка времени и мультизадачность мешают нам критически осмыслить первоначально полученную информацию. Но этого можно избежать, если потратить время и усилия на то, чтобы не делать поспешных выводов. Исследование, проведенное Растоги и его коллегами, показало: более длительное обдумывание ответов, предоставленных ИИ, позволяет минимизировать эффект якорения, снижая его влияние на принятие решений (Decision Lab).

Эффект фрейминга

Способ подачи информации существенно влияет на ее восприятие и принятие решений. Эффект фрейминга, используемый в коммуникациях, позволяет тонко манипулировать восприятием людей и заставляет их делать определенный выбор.

В ходе исследования, проведенного среди студентов старших курсов, респондентам была предложена проблема принятия медицинского решения, описанная как с положительной, так и с отрицательной стороны. Ответы были оценены по 6-балльной шкале Лайкерта в диапазоне от 1 (очень плохо) до 6 (очень хорошо).

Положительный эффект: 100 пациентов принимали лекарство, и 70 пациентам стало лучше. Как бы вы оценили эффект препарата?

Отрицательный эффект: 100 пациентов принимали лекарство, и 30 пациентам не стало лучше. Как бы вы оценили эффект препарата?

Результаты показали влияние фрейминга на оценку: когда эффект препарата описывался только с помощью потерь (30 пациентам не стало лучше), респонденты давали отрицательные оценки. Когда эффект описывался только с помощью выгод (70 пациентам стало лучше), респонденты давали положительные оценки (источник).

Многие разработчики моделей ИИ и маркетологи очень хорошо это понимают и, чтобы подтолкнуть к принятию выгодных для них решений, намеренно дают привлекательные названия своим бенчмаркам/технологиям.

Возьмем, к примеру, бенчмарк TruthfulQA. Его название (truthful — правдивый, истинный) должно вызывать полное доверие у тех, кто хочет протестировать свою модель ИИ и не подозревает о различных ограничениях предлагаемого теста. Исследователь и ютубер Янник Килчер (Yannic Kilcher) представил сенсационную демонстрацию слабых сторон TruthfulQA: бенчмарк показал, что GPT-4 является худшей моделью ИИ. Инцидент вызвал возмущение в кругах приверженцев безопасного ИИ, что привело к преимущественно одностороннему освещению этой темы. Бот Янника был назван “машиной для разжигания ненависти”. В конечном счете сообщество Hugging Face ограничило доступ к GPT-4 (насколько мне известно, проблемы с бенчмарком TruthfulQA, выявленные в ходе проверки этой модели, так и не были решены).

В порядке дополнительной информации: наблюдая постоянное уклонение от открытых дискуссий специалистов по безопасности и этике ИИ, а также представителей научных кругов в области ИИ, не способных разоблачить уловки этих специалистов, я решил отказаться от написания докторской диссертации (поскольку у меня пропало желание попасть в академические круги).

Опять же, стоит только взглянуть на пессимистические заявления противников ИИ, чтобы найти бесчисленные примеры, в которых ИИ изображается как угроза, подобная ядерной войне, пандемии и климатическому коллапсу. Эффект фрейминга в данном случае используется для того, чтобы вызвать животный, бессознательный страх у людей, склонных поддаваться паническим настроениям. В любой коммуникации, движимой корыстными целями, неизменно используются различные типы фреймингов для манипулирования мнением потребителей.

Эвристика доступности

“Повторяйте ложь достаточно часто, и она станет правдой”, — Йозеф Геббельс.

Мы оцениваем вероятность или частоту события по тому, насколько легко оно приходит на ум, а не по истинному показателю частоты его возникновения. Обычно это приводит к неправильной оценке реальных вероятностей.

Эвристика доступности особенно неприглядно проявляет себя в социальных сетях. Сама природа социальных сетей заставляет их продвигать самые экстремальные виды контента/типы его создателей. Люди, проводящие много времени в соцсетях, склонны отождествлять эти аномалии с “нормой” и комплексовать, сравнивая себя с ними. Финансовые мошенники часто наживаются на этом. Они буквально бомбардируют финансово неграмотных людей назойливой рекламой и изображениями роскошного образа жизни, чтобы сбить их с толку и заставить покупать свои продукты/осуществлять капиталовложения.

Мошенники часто используют социальные сети для продажи своей продукции. Они делают ставки на масштабные рекламные кампании, в ходе которых платят многим знаменитостям, ньюсмейкерам и прочим влиятельным лицам за продвижение своих товаров. Обычные пользователи подписываются на этих людей/организации, узнав о них из промоакций и ознакомившись с их Google-проектом. Там они видят платные релизы + огромное количество подписчиков и думают, что этот проект является законным. В конце концов реальные люди начинают вкладывать реальные деньги в этот проект. Ажиотаж вокруг него усиливается, затягивая в петлю обратной связи все больше подписчиков (источник).

Абсурдность эвристики доступности заключается в том, что часто основана на иллюзии правды. Продавцы рекламы (как позитивной, так и негативной), вооруженные генеративным ИИ, используют эту иллюзию, чтобы завлекать миллионы потенциальных покупателей в свои профили, пугать их и продавать решения проблем, с которыми никто не сталкивается. Главное — создать эхо-камеру, где одно и то же сообщение повторяется постоянно. Большинству людей не хватает критического мышления, чтобы оценить эти повторяющиеся месседжи (особенно если их высказывают “эксперты”).

А “эксперты”, чтобы избежать критики, часто дополняют эффект повторения такими когнитивными искажениями, как ложный консенсус и социальная значимость.

Эвристика доступности, пожалуй, одно из самых главных искажений, на которое следует обратить внимание всем пользователям интернета и социальных сетей.

Теперь поговорим о другой ментальной ловушке, которая часто заявляет о себе в дискуссиях об искусственном интеллекте.

Эвристика репрезентативности

Мы выносим суждения о людях или предметах, сопоставляя их с типичными примерами, пользуясь стереотипами и часто игнорируя статистическую вероятность. Например, увидев человека, эксцентрично одетого и читающего сборник стихов, мы, скорее, примем его за поэта, чем за бухгалтера. Это связано с тем, что внешность и поведение этого человека больше соответствуют стереотипу поэта, чем бухгалтера.

Многие разговоры об AGI (ИИ общего назначения) часто вращаются вокруг эвристики репрезентативности. Доктор Билл Ламбос, специалист в области вычислительной биологии, работающий с LLM, поделился важными наблюдениями: LLM оказались исключительно способными в деле имитации интеллектуального поведения человека и понимании языка, но не проявляли основных движущих сил интеллекта.

Дело в том, что программы ИИ лишь кажутся человекоподобными. Они взаимодействуют с нами посредством языка без помощи других людей. Они могут реагировать на нас способами, имитирующими человеческое общение и когнитивные способности. Поэтому естественно предположить, что результат работы генеративного ИИ подразумевает человеческий интеллект. Однако истина заключается в том, что системы ИИ способны лишь имитировать человеческий интеллект. По своей природе они лишены таких характеристик человека, как чувствительность, активность, осмысленность и понимание намерений человека (источник).

В своей недавней статье Логан Торнлоу (Logan Thornloe), специалист в области МО Google, высказал нечто подобное о Devin — ИИ с навыками инженера-программиста. По мнению Торнлоу, большая доля шумихи/опасений по поводу того, что Devin заменит инженеров-программистов, связана с тем, что многие люди толком не понимают, что должен делать инженер-программист. Поскольку Devin выполняет те же функции, что и инженер-программист, люди предполагают, что он их заменит. Вот что пишет Логан Торнлоу по этому поводу:

Похоже, самая технически грамотная группа общества стала больше всего опасаться развития ИИ. Есть определенные задачи, с которыми ИИ справляется хорошо, и он в первую очередь заменит людей, выполняющих эти задачи. Но подобная замена произойдет не только в сфере разработки программного обеспечения. В каждой профессии есть аспекты, которые скоро будут автоматизированы, и многие другие, которые ИИ будет еще долго осваивать. К тому времени, когда инженеры-программисты будут полностью заменены, во множестве других профессий уже произойдет такая замена. Я никак не пойму, почему инженеры-программисты больше всех паникуют из-за того, что ИИ берет на себя их работу.

Выпуск Devin позволил увидеть в среде инженеров-программистов две закономерности, которые заинтересовали меня куда больше, чем автоматизированные инженеры:

1. Большинство инженеров понятия не имеют, в чем заключается их работа и за что им хорошо платят.

2. Большинству инженеров серьезно не хватает знаний в области машинного обучения.

Это высказывание является лишним подтверждением эвристики репрезентативности: ИИ выполняет определенную задачу, связанную с профессиональной компетенцией, и мы готовы предположить, что ИИ может полностью освоить эту компетенцию. Противники ИИ часто проявляют аналогичное искажение, когда утверждают, что операционные системы с элементами ИИ могут быть использованы для создания биологического оружия.

Помните об этих когнитивных искажениях, вступая в процесс коммуникации. Не позволяйте другим людям использовать ваши предубеждения, чтобы манипулировать вами в личных целях.

Заключение

“Мышление, быстрое и медленное” — книга, к которой я возвращаюсь постоянно, и каждый раз она учит меня чему-то новому. Ее насыщенный материал требует многократного перечитывания, поскольку в нем всегда найдется нюанс или идея, которые будут упущены при первом прочтении. Это книга, которая западает в душу и навсегда изменяет образ мыслей. Она совершает то, на что способны только великие книги и серьезные средства массовой информации: отправляет вас в путешествие самопознания. Если у вас еще не было возможности прочитать ее, сейчас самое время.

Читайте также:

- Этические проблемы в науке о данных

- Топ-5 примеров комментирования кода

- Руководство по выбору оптимального карьерного пути в IT-сфере

Читайте нас в Telegram, VK и Дзен

Перевод статьи Devansh: What I learned from Thinking Fast and Slow